Goose 完全ガイド:2026 年 Block 社が提供するオープンソース AI 開発エージェント

公開日:2026 年 3 月 ・ バージョン:v1.0+ ・ ライセンス:Apache 2.0 ・ 実行方式:ローカル実行

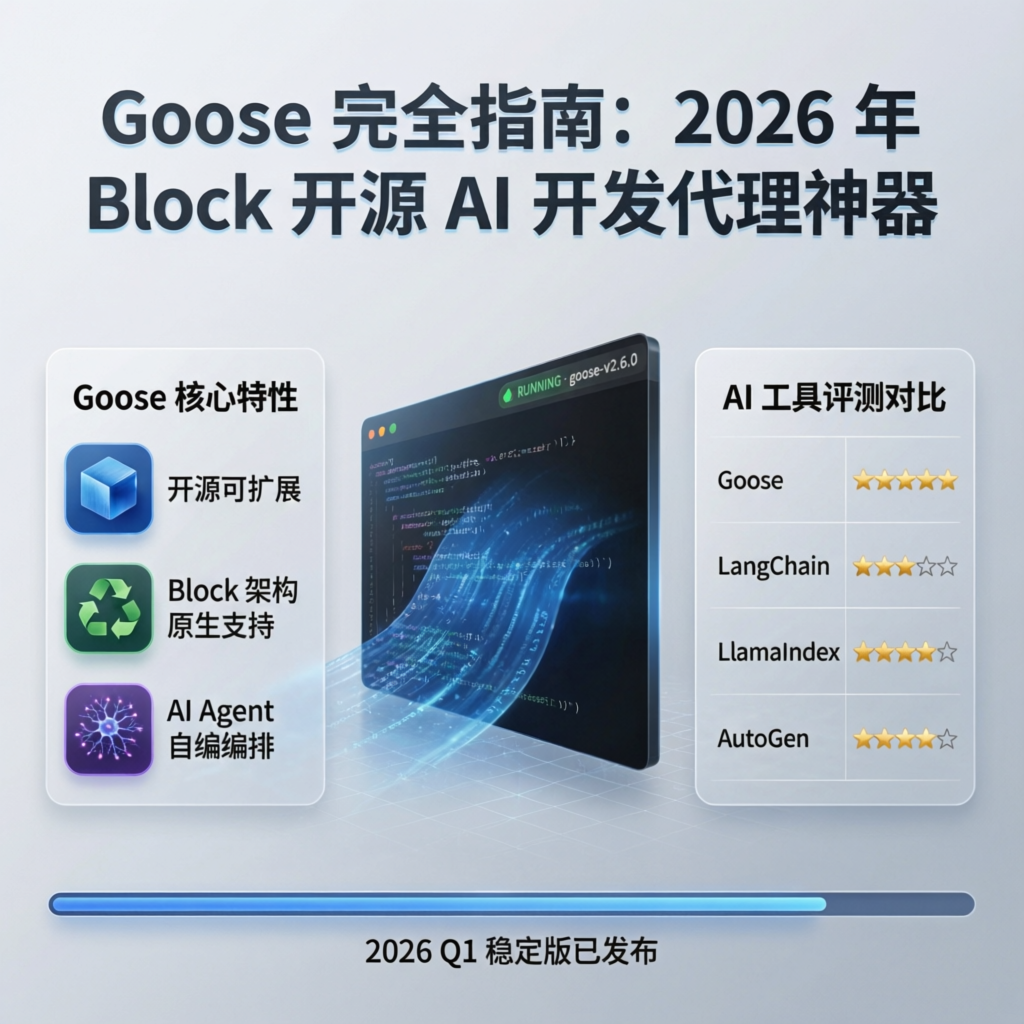

2026 年初頭、Block 社(旧 Square 社)は、複雑な開発タスクを自律的に遂行可能な AI エージェント(AI Agent)である Goose を正式にオープンソース化しました。従来のコード補完ツールとは異なり、Goose は単にコードを生成するだけでなく、コマンドの実行、エラーのデバッグ、ワークフローの編成、さらにはゼロから完全なプロジェクトを構築することも可能です。

Goose の核心的なコンセプトは「on-machine AI agent(マシン上での AI エージェント)」です。すべての処理はローカルで実行されるため、コードの機密性とセキュリティが確保されます。また、任意の LLM プロバイダーに対応しており、複数のモデルを組み合わせた戦略的運用により、パフォーマンスとコストの最適化が可能です。さらに、外部ツールやサービスとのシームレスな統合を実現するために、MCP(Model Context Protocol)プロトコルを採用しています。

なぜGooseを選ぶべきか?

主な機能の比較

| 機能 | Goose | GitHub Copilot | Cursor | Devin |

|---|---|---|---|---|

| オープンソースライセンス | ✅ Apache 2.0 | ❌ 非オープンソース | ❌ 非オープンソース | ❌ 非オープンソース |

| ローカル実行 | ✅ 完全ローカル実行 | ❌ クラウドのみ | ⚠️ ハイブリッド(ローカル+クラウド) | ❌ クラウドのみ |

| 自立実行機能 | ✅ コマンドの実行が可能 | ❌ 提言のみ | ⚠️ 制限付き | ✅ |

| 複数LLM対応 | ✅ 任意のLLMをサポート | ❌ 固定モデルのみ | ⚠️ 制限付き | ❌ 固定モデルのみ |

| MCP統合 | ✅ ネイティブ対応 | ❌ | ❌ | ❌ |

| ワークフロー編成 | ✅ 自由にカスタマイズ可能 | ❌ | ⚠️ 制限付き | ✅ |

| 価格 | ✅ 無料 | $10~19/月 | $20/月 | $500/月 |

適用シーン

✅ おすすめの利用ケース:

- 繰り返し発生する開発タスクの自動化が必要な場合

- コードの機密性を守るため、ローカルでの実行が必須な場合

- LLMプロバイダーを柔軟に選択したい場合

- 複雑な複数ステップからなるワークフローを構築したい場合

- 予算が限られている個人開発者やチームの場合

❌ あまり向いていないケース:

- 単純なコード補完のみが必要な場合

- コマンドライン操作に慣れていない場合

- 企業レベルのSLA(サービスレベルアグリーメント)対応を必要とする場合

クイックスタート

システム要件

- オペレーティングシステム:macOS 12以上 / Windows 10以上 / Linux(Ubuntu 20.04以上)

- メモリ:最低8GB、推奨16GB以上

- ストレージ:最低2GBの空き容量

- Python:3.10以上

- Node.js:18以上(一部拡張機能で任意)

インストール方法

方法1:pipによるインストール(推奨)

# Gooseのインストール

pip install goose-ai

# インストールの確認

goose --version

方法2:ソースコードからのインストール

# リポジトリのクローン

git clone https://github.com/block/goose.git

cd goose

# 依存関係のインストール

pip install -e .

# デスクトップアプリケーションのビルド(任意)

npm install && npm run build

方法3:Homebrewによるインストール(macOSのみ)

brew install goose-ai

初期設定

Gooseを初めて実行する際には、LLMプロバイダーの設定が必要です。

# 設定ウィザードの起動

goose configure

# または、設定ファイル `~/.config/goose/config.yaml` を手動で編集

設定ファイルの例:

providers:

- name: openai

api_key: ${OPENAI_API_KEY}

models:

- gpt-4o

- gpt-4-turbo

- name: anthropic

api_key: ${ANTHROPIC_API_KEY}

models:

- claude-3-5-sonnet

- claude-3-opus

- name: ollama

base_url: http://localhost:11434

models:

- qwen3-coder:32b

- llama3:70b

default_model: claude-3-5-sonnet

workspace: ~/projects

コア機能の詳細解説

1. 自律的タスク実行

Goose の最も強力な機能は、複数ステップからなるタスクを自律的に完了させることです。たとえば、完全な API サービスを作成する場合:

# Goose に要件を指示します

goose run "FastAPI プロジェクトを作成し、ユーザー登録・ログイン機能および JWT 認証機能を含める"

Goose は自動的に以下の処理を行います:

1. プロジェクト構造および必要なファイルの作成

2. ルーティング、データモデル、認証ロジックの実装

3. 依存パッケージのインストール

4. 機能検証のためのテスト実行

5. API ドキュメントの生成

2. MCP サーバー連携

Goose は MCP(Model Context Protocol)をネイティブでサポートしており、さまざまな外部ツールと連携できます:

# 設定ファイルに MCP サーバーを追加

mcp_servers:

- name: filesystem

command: npx

args: ["-y", "@modelcontextprotocol/server-filesystem", "~/projects"]

- name: github

command: npx

args: ["-y", "@modelcontextprotocol/server-github"]

env:

GITHUB_TOKEN: ${GITHUB_TOKEN}

- name: postgres

command: npx

args: ["-y", "@modelcontextprotocol/server-postgres"]

env:

DATABASE_URL: postgresql://localhost:5432/mydb

代表的な MCP サーバー:

| サーバー | 機能 | インストールコマンド |

|---|---|---|

| filesystem | ファイルシステム操作 | @modelcontextprotocol/server-filesystem |

| github | GitHub API 連携 | @modelcontextprotocol/server-github |

| postgres | PostgreSQL データベース連携 | @modelcontextprotocol/server-postgres |

| slack | Slack メッセージ送信 | @modelcontextprotocol/server-slack |

| puppeteer | ブラウザ自動化 | @modelcontextprotocol/server-puppeteer |

3. 複数モデル戦略

Goose は、タスクの種類に応じて異なる AI モデルを柔軟に切り替えて使用でき、コストとパフォーマンスを最適化します:

routing:

# コード生成には高性能モデルを使用

code_generation:

model: claude-3-5-sonnet

max_tokens: 4096

# 単純なタスクにはローカルモデルを使用

simple_tasks:

model: ollama/qwen3-coder:7b

max_tokens: 2048

# コードレビューにはコスト効率の高いモデルを使用

code_review:

model: gpt-4o-mini

max_tokens: 1024

4. 拡張システム(Extensions)

Goose はカスタム拡張(Extensions)をサポートしており、特定のドメインやユースケースに特化した機能を追加できます:

# extensions/my_extension.py

from goose.extensions import Extension

class MyExtension(Extension):

"""カスタム拡張のサンプル"""

def __init__(self):

self.name = "my-extension"

self.version = "1.0.0"

async def deploy_to_server(self, project_path: str):

"""サーバーへのデプロイに関するカスタムロジック"""

# デプロイ処理を実装

pass

async def run_tests(self, project_path: str):

"""テスト実行に関するカスタムロジック"""

# テスト処理を実装

pass

実践ケース

ケース 1:自動化データ移行

# 移行タスクを作成

goose run "

MySQL データベース内のユーザー情報を PostgreSQL に移行:

1. MySQL の `users` テーブルを読み込む

2. データ構造を PostgreSQL に適合させるよう変換する

3. PostgreSQL データベースに書き込む

4. データの完全性を検証する

5. 移行レポートを生成する

"

ケース 2:一括コードリファクタリング

# プロジェクト全体のエラー処理をリファクタリング

goose run "

プロジェクト内のすべての Python ファイルにおけるエラー処理をリファクタリング:

- `try-except` ブロックを、カスタム例外クラスで統一的に使用するように変更

- 適切なログ記録を追加

- すべての API 呼び出しに対して再試行ロジックを実装

- 新しい例外に対応したテストケースを更新

"

ケース 3:API ドキュメントの自動生成

# コードから完全な API ドキュメントを生成

goose run "

プロジェクトの API ルーティングを解析し、以下のものを生成:

1. OpenAPI 3.0 仕様ファイル

2. Markdown 形式の利用者向けドキュメント

3. Postman コレクションファイル

4. 対話型 API テストページ

"

最佳実践

1. セキュリティ設定

# Goose の権限範囲を制限する

security:

# 許可されるコマンドのホワイトリスト

allowed_commands:

- git

- npm

- pip

- python

- docker

# アクセスを禁止するディレクトリ

blocked_paths:

- ~/.ssh

- /etc/passwd

- /etc/shadow

# 確認を要する危険な操作

require_confirmation:

- rm -rf

- DROP TABLE

- DELETE FROM

2. パフォーマンス最適化

# 最適化設定

performance:

# 並列実行タスク数

max_concurrent_tasks: 4

# 個別のタスクタイムアウト(秒)

task_timeout: 300

# キャッシュの有効化

cache:

enabled: true

ttl_hours: 24

# ストリーミング出力(メモリ使用量を削減)

streaming: true

3. ログおよびデバッグ

# 詳細ログを有効化

goose run "タスクの説明" --verbose

# 実行履歴を表示

goose history --limit 10

# セッションレポートをエクスポート

goose report --format markdown --output session-report.md

よくある質問

Q1: Goose と Cursor の違いは何ですか?

A: Cursor は IDE プラグインであり、主にコード補完およびチャット機能を提供します。一方、Goose は独立した AI エージェントで、コマンドの自動実行やワークフローの編成が可能です。両者は連携して利用できます:自動化タスクには Goose を、対話型開発には Cursor を使用してください。

Q2: ローカルモデルを使用できますか?

A: はい!Goose は Ollama や LM Studio などのローカル推論バックエンドをサポートしています。設定例を以下に示します:

providers:

- name: ollama

base_url: http://localhost:11434

models:

- qwen3-coder:32b

Q3: 機密情報はどのように保護されますか?

A: Goose は環境変数および暗号化された設定ファイルによる機密情報の保護をサポートしています:

# 環境変数を使用する場合

export OPENAI_API_KEY="sk-..."

goose run "タスク"

# または暗号化された設定ファイルを使用する場合

goose config encrypt

Q4: 中国語をサポートしていますか?

A: はい、完全にサポートしています!中国語に最適化されたモデル(例:Qwen3 Coder、DeepSeek Coder)を使用することで、最も優れた結果を得られます。

コミュニティとリソース

- GitHub: https://github.com/block/goose

- 公式ドキュメント: https://block.github.io/goose/

- Discord コミュニティ: https://discord.gg/goose-oss

- MCP サーバー一覧: https://github.com/modelcontextprotocol/servers

まとめ

Goose は、2026 年における AI 開発ツールの新たな方向性——「コーディング補助」から「自律的開発」への進化——を象徴する存在です。ローカル実行、複数モデル対応、および MCP エコシステムとの統合という特長により、Goose は開発者に強力で柔軟かつプライバシー保護を重視した AI エージェントプラットフォームを提供します。

複雑な開発タスクの自動化、ソースコードの機密性保護、あるいはカスタム AI ワークフローの構築を必要とするチームにとって、Goose は導入価値の高いツールです。今後、MCP エコシステムがさらに成熟し、コミュニティによる拡張機能が豊かになっていくにつれ、Goose の機能範囲も継続的に広がっていくでしょう。

関連リソース: